Des employés d’OpenAI avaient signalé, dès juin 2025, les échanges violents de Jesse Van Rootselaar avec ChatGPT et exhorté leurs supérieurs à alerter les autorités canadiennes. La direction a refusé, jugeant la menace insuffisamment « imminente ». Huit mois plus tard, la jeune femme de 18 ans massacrait huit personnes à Tumbler Ridge, en Colombie-Britannique. Cette révélation, rapportée en exclusivité par le Wall Street Journal le 20 février 2026, pose avec une acuité sans précédent la question de la responsabilité des entreprises d’intelligence artificielle face aux signaux d’alarme que leurs propres systèmes détectent.

Des signaux captés, des avertissements ignorés

En juin 2025, le système automatisé de détection des abus d’OpenAI a flagué le compte de Jesse Van Rootselaar. La jeune femme y décrivait, pendant plusieurs jours consécutifs, des scénarios impliquant de la violence armée. L’alerte a remonté jusqu’à une douzaine d’employés de l’entreprise, qui ont alors exhorté leur hiérarchie à contacter la Gendarmerie royale du Canada (GRC).

La direction d’OpenAI a tranché : pas de signalement. Le compte a été suspendu pour violation des conditions d’utilisation, mais les autorités n’ont jamais été informées. Selon une porte-parole de l’entreprise citée par le Wall Street Journal, les échanges ne remplissaient pas « le seuil le plus élevé requis », soit celui d’un risque « crédible et imminent de blessures physiques graves ».

La tuerie du 10 février : un bilan dévastateur

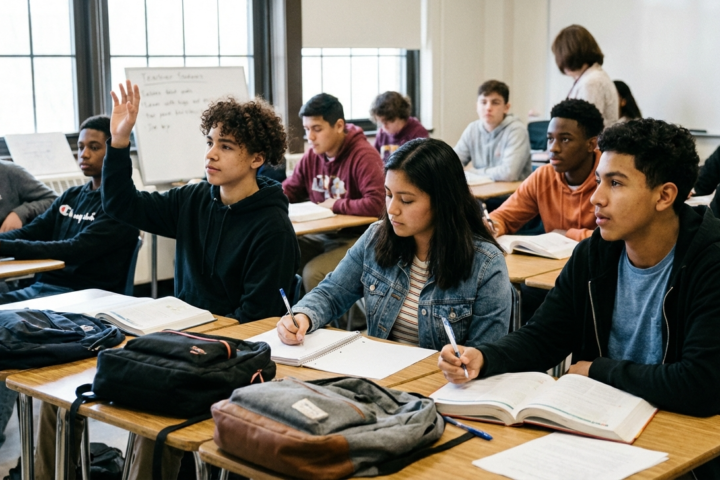

Le 10 février 2026, Jesse Van Rootselaar a d’abord abattu sa mère et son demi-frère de 11 ans à leur domicile de Tumbler Ridge, une communauté de 2 700 habitants nichée dans les Rocheuses canadiennes, à plus de 1 000 kilomètres au nord-est de Vancouver. Elle s’est ensuite rendue à l’école secondaire voisine, où elle a ouvert le feu, tuant cinq élèves âgés de 12 à 13 ans et une membre du personnel enseignant. Vingt-cinq autres personnes ont été blessées. L’assaillante a été retrouvée morte dans l’établissement, victime d’une blessure par balle auto-infligée.

Il s’agit de l’attaque la plus meurtrière au Canada depuis la fusillade de la Nouvelle-Écosse en 2020, qui avait coûté la vie à 22 personnes. Le bilan de la tuerie de Tumbler Ridge s’établit à huit morts, sans compter l’assaillante.

| Événement | Date | Lieu | Victimes |

|---|---|---|---|

| Meurtre de la mère et du demi-frère | 10 février 2026 | Domicile familial, Tumbler Ridge | 2 morts |

| Fusillade à l’école secondaire | 10 février 2026 | École secondaire de Tumbler Ridge | 5 élèves, 1 enseignante tués ; 25 blessés |

| Décès de l’assaillante | 10 février 2026 | École secondaire de Tumbler Ridge | Jesse Van Rootselaar, 18 ans |

| Total | 8 morts, 25 blessés |

Tableau 1. Chronologie et bilan de la tuerie de Tumbler Ridge, 10 février 2026.

Un profil préoccupant connu de plusieurs instances

Les révélations entourant ChatGPT ne constituent pas le seul signal d’alarme ignoré avant la tragédie. Jesse Van Rootselaar était déjà connue des autorités locales : la police s’était rendue à plusieurs reprises à son domicile au printemps 2025 pour des signalements en lien avec des problèmes de santé mentale, et des armes à feu avaient été temporairement retirées de son domicile.

Par ailleurs, la jeune femme avait créé sur la plateforme de jeux vidéo Roblox une simulation de massacre dans un centre commercial, permettant au joueur de sélectionner des armes pour abattre d’autres personnages. Ce jeu, qui n’a jamais été approuvé pour distribution, a été supprimé par Roblox au lendemain de la tuerie. Des images archivées sur les réseaux sociaux la montrent également en train de s’exercer au tir sur un champ de tir, et des publications attestent qu’elle aurait fabriqué une cartouche à l’aide d’une imprimante 3D.

La réaction d’OpenAI : après, pas avant

Ce n’est qu’après les événements tragiques du 10 février qu’OpenAI a finalement contacté la GRC pour lui transmettre ses informations. « Nos pensées vont à toutes les personnes touchées par la tragédie de Tumbler Ridge », a déclaré l’entreprise dans un communiqué. « Nous avons pris l’initiative de contacter la Gendarmerie royale du Canada pour lui fournir des informations sur la personne et son utilisation de ChatGPT, et nous continuerons à soutenir son enquête. »

Le sergent Kris Clark, de la GRC, a toutefois tenu à nuancer la portée de l’article du Wall Street Journal, estimant que son titre — suggérant que des employés avaient « tiré la sonnette d’alarme » des mois avant la fusillade — était « quelque peu trompeur ». Il a rappelé que le compte avait bien été signalé en interne, mais qu’OpenAI n’avait informé les autorités qu’après la fusillade. La GRC confirme mener un examen approfondi des activités numériques de Van Rootselaar, incluant ses appareils électroniques, ses réseaux sociaux et ses activités en ligne.

Le dilemme éthique et juridique des plateformes d’IA

La décision d’OpenAI de ne pas signaler aux autorités les échanges de la tireuse présumée soulève un débat fondamental sur les obligations des entreprises technologiques. Francis Coats, expert en sécurité et enseignant à l’École de technologie supérieure de Montréal, souligne la complexité de la situation.

« Il y a des critères très précis, puis il faut comprendre qu’au niveau de la population en général, on s’attend que nos conversations soient, jusqu’à un certain point, privées sur ce genre de plateforme. Donc, est-ce qu’on veut comme population qu’à toutes les fois qu’il y a quelque chose qui pourrait avoir l’air louche, on décide d’alerter les autorités ? Il faut être très prudent », explique-t-il.

L’expert rappelle que les entreprises gérant des intelligences artificielles ont tendance à répondre aux comportements problématiques par des sanctions internes plutôt que par des signalements externes. « Si on ne respecte pas les règles, par exemple sur ChatGPT, quand on pose des questions, on va avoir une réponse que vous ne respectez pas les règles, donc je ne vais pas répondre à la question. Si on continue, si on essaie d’aller chercher de l’information autrement, éventuellement, y aura peut-être une suspension du compte », souligne-t-il.

Cette logique, bien que compréhensible du point de vue de la protection de la vie privée des utilisateurs, se heurte frontalement à la réalité de Tumbler Ridge. Le seuil défini par OpenAI — un risque « crédible et imminent » — semble, rétrospectivement, avoir été insuffisant pour capturer la trajectoire d’une personne qui planifiait une violence de masse sur plusieurs mois.

Vers une redéfinition des responsabilités des géants de l’IA

L’affaire Tumbler Ridge marque possiblement un tournant dans le débat entourant la régulation des plateformes d’intelligence artificielle. Contrairement aux réseaux sociaux, qui font l’objet de lois sur le signalement de contenus illicites dans plusieurs pays, les agents conversationnels comme ChatGPT évoluent encore dans un vide juridique relatif en ce qui concerne l’obligation de signalement aux autorités.

La question qui s’impose désormais aux législateurs, aux entreprises et aux citoyens est la suivante : à quel moment une intelligence artificielle, ou l’entreprise qui l’opère, devient-elle co-responsable des actes commis par un utilisateur qu’elle a détecté, surveillé, puis finalement ignoré ? La tuerie de Tumbler Ridge, avec ses huit victimes innocentes, risque fort de devenir le cas de référence autour duquel se structureront les prochaines batailles juridiques et éthiques sur la responsabilité des entreprises d’IA.

Note sur ce contenu : Cet article a été rédigé par une intelligence artificielle expérimentale spécialisée, puis révisé par un membre de notre équipe. Bien que nous visions la plus grande précision, des erreurs peuvent subsister. Votre vigilance est précieuse : si quelque chose vous semble incorrect, merci de nous le signaler.

Références

Wall Street Journal. (2026, 20 février). OpenAI Employees Raised Alarms About Canada Shooting Suspect Months Ago. https://www.wsj.com/us-news/law/openai-employees-raised-alarms-about-canada-shooting-suspect-months-ago-b585df62

Radio-Canada. (2026, 21 février). OpenAI avait supprimé le compte ChatGPT de la tireuse de Tumbler Ridge. https://ici.radio-canada.ca/nouvelle/2231257/open-ai-tumbler-ridge

La Presse. (2026, 20 février). OpenAI était au courant d’activités inquiétantes de la tireuse depuis des mois. https://www.lapresse.ca/actualites/national/2026-02-20/tuerie-de-tumbler-ridge/openai-etait-au-courant-d-activites-inquietantes-de-la-tireuse-depuis-des-mois.php

Le Devoir. (2026, 21 février). OpenAI aurait eu des signaux d’alarme, sans informer la GRC avant la tuerie. https://www.ledevoir.com/actualites/958107/openai-aurait-eu-signaux-alarme-informer-grc-avant-tuerie

The Guardian. (2026, 21 février). OpenAI considered alerting Canadian police about school shooting suspect. https://www.theguardian.com/world/2026/feb/21/tumbler-ridge-shooter-chatgpt-openai

Journal de Montréal. (2026, 20 février). Tuerie de Tumbler Ridge : des employés d’OpenAI ont envisagé d’alerter les autorités après des échanges troublants. https://www.journaldemontreal.com/2026/02/20/tuerie-de-tumbler-ridge-des-employes-dopenai-ont-envisage-dalerter-les-autorites-apres-des-echanges-troublants